宝子们,小米又搞大事情啦👏!小米今日正式发布并且全量开源了 MiDashengLM-7B 多模态大模型,这可是专注于音频理解的 AI 模型哦,在性能和效率方面都有超显著的突破🎉

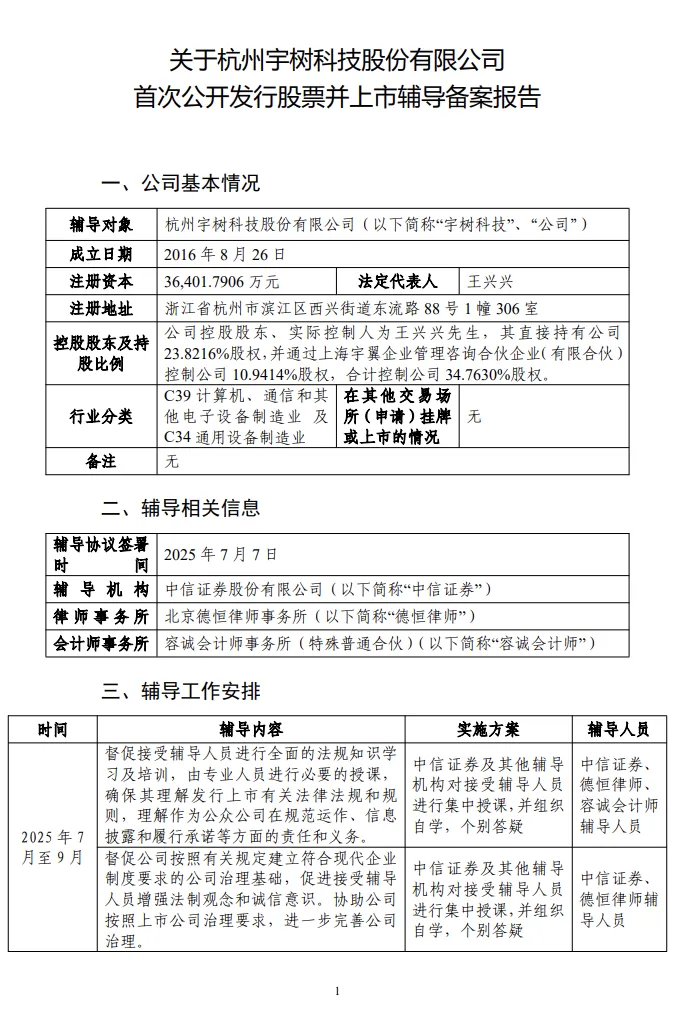

先说说技术架构🧐,它采用创新的双核心架构设计,用 Xiaomi Dasheng 作为音频编码器,结合 Qwen2.5-Omni-7B Thinker 作为自回归解码器。这种设计把专业音频处理能力和强大语言理解能力巧妙融合,为模型厉害的表现打下了技术基础。而且它最大的亮点是通用音频描述训练策略,打破了传统音频 AI 模型只专注单一声音处理的局限,能统一理解语音、环境声音和音乐,这种全域音频理解能力在业界可太少见啦👍

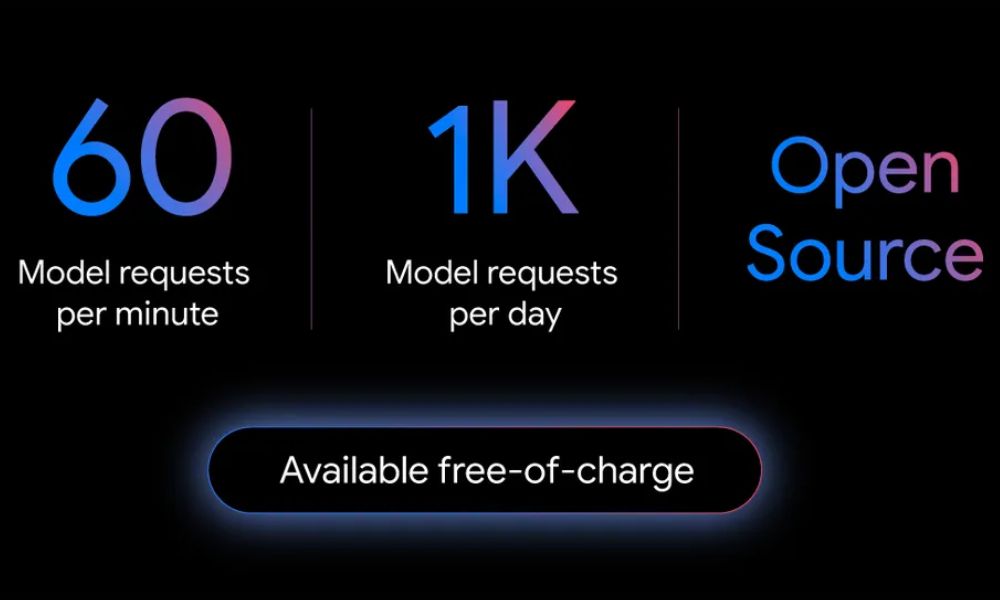

性能方面更是亮眼✨,在 22 个公开评测集上刷新了多模态大模型的最好成绩,这足以证明它在音频理解领域的技术领先地位。推理效率提升得也超夸张,单样本推理的首 Token 延迟只有业界先进模型的四分之一,相同显存条件下,数据吞吐效率比业界先进模型高出 20 倍以上。这得益于小米在模型架构优化和训练策略改进上的技术积累,在保持高精度的同时降低了计算开销👏

MiDashengLM-7B 是小米 Dasheng 系列模型的重要升级版本哦。Xiaomi Dasheng 音频编码器经过多代技术迭代优化,已经有了成熟技术体系。新模型在前作基础上全面升级,音频理解准确性和计算效率都大幅提升啦🥳

未来规划也超值得期待😆,小米已经在对该模型进行计算效率的进一步升级,目标是在终端设备上实现离线部署。这意味着用户能在不依赖云端服务的情况下享受高质量音频 AI 服务,隐私保护更好,使用成本更低,还能为小米在 IoT 生态里的音频 AI 应用提供技术支持。另外,小米还在完善基于用户自然语言提示的声音编辑功能,以后通过简单文字描述就能完成复杂音频处理任务,音频编辑技术门槛大大降低啦🤩

小米选择全量开源 MiDashengLM-7B,真的超有意义👏。这能推动整个音频 AI 领域的技术进步,给研究者和开发者提供学习改进的好机会。开源能加速音频 AI 技术的普及应用,让更多创新应用出现,推动行业生态繁荣发展🎉

宝子们,感觉音频 AI 的新时代要来了,你们对这个 MiDashengLM-7B 怎么看呀🧐,快来评论区聊聊😜

#小米 #MiDashengLM7B #音频 AI #开源模型 #多模态大模型 #音频理解 #技术突破 #推理效率